Le Generative Adversarial Networks (GAN), introdotte da Ian J. Goodfellow nel 2014, rappresentano per Massimo Leone un punto di osservazione privilegiato per una semiotica dell’intelligenza artificiale. Il loro funzionamento si fonda su un’architettura dialettica: due moduli — un generatore e un discriminatore — si confrontano in un processo di apprendimento competitivo. Il primo produce rappresentazioni (per esempio, immagini), mentre il secondo valuta se esse provengano dai dati reali o siano state generate artificialmente.

Questa struttura, osserva Leone, è interpretabile in termini attanziali. Il modulo generatore (G) «mira a “far sembrare” e quindi a “far passare per vero” ciò che non lo è», mentre il discriminatore (D) «mira a “far apparire” e quindi a “smascherare come falso” ciò che non è vero». La relazione tra i due è al tempo stesso antagonistica e cooperativa: D è l’anti-soggetto di G, ma anche il suo destinatario e coadiuvante, poiché ogni sanzione contribuisce all’apprendimento del generatore.

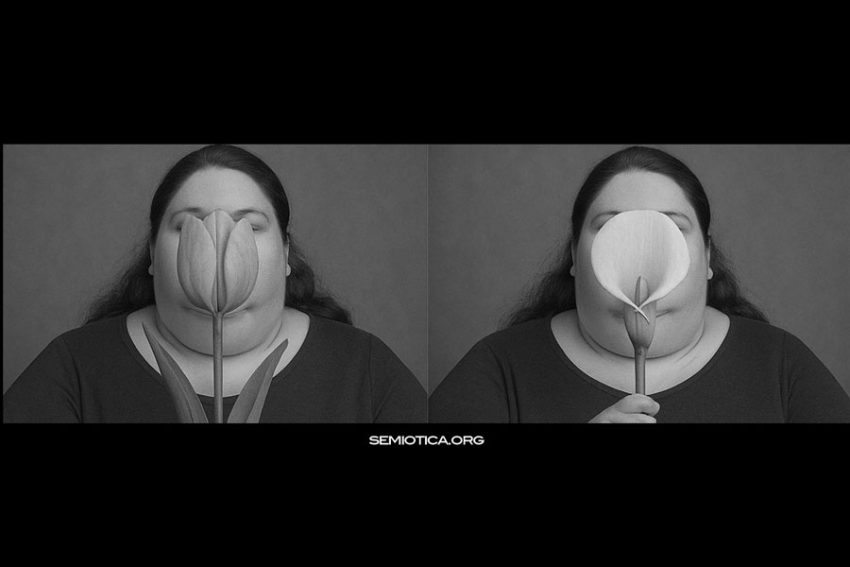

Leone illustra questo processo con una doppia metafora. La prima è quella del falsario e dell’intenditore: il primo produce imitazioni sempre più convincenti, il secondo cerca di smascherarle, ma nel farlo fornisce indirettamente informazioni utili al falsario per migliorare le sue tecniche.

La seconda metafora è quella dello studente e dell’insegnante: il generatore (G) si comporta come uno studente che tenta di produrre rappresentazioni credibili a partire da un insieme di dati, mentre il discriminatore (D) svolge il ruolo dell’insegnante, valutando la qualità di tali rappresentazioni e fornendo implicitamente indicazioni su come migliorarle. Tuttavia, osserva Leone, la differenza decisiva rispetto a un contesto educativo tradizionale è che le rappresentazioni prodotte dal “modulo studente” (cioè il generatore) non restano confinate all’ambito dell’apprendimento. Esse cominciano a circolare autonomamente nello spazio sociale, slegate dal loro processo formativo. In altri termini, non sono più sottoposte a verifica né destinate solo a scopi didattici, ma si presentano come “prodotti finiti”, pronti a generare effetti comunicativi nel mondo reale, senza che gli osservatori possano risalire alla loro origine artificiale o al contesto di apprendimento da cui provengono.

Questo genera una spirale del falso, in cui i prodotti del modulo generatore non sono più facilmente distinguibili dal reale. L’incertezza non riguarda solo l’algoritmo discriminatore, ma soprattutto l’osservatore umano — sia quello esperto (programmatore o analista), sia quello comune — che si trova sempre più in difficoltà nel riconoscere l’origine delle rappresentazioni.

Leone descrive il passaggio storico rappresentato da questa tecnologia. Il falso analogico — pittorico, narrativo, retorico — conservava sempre un certo scarto rispetto alla realtà ontologica. Il falso digitale, invece, è in grado di riprodurre l’effetto di realtà anche in assenza di referenza. La fotografia analogica poteva far credere all’esistenza degli oggetti rappresentati, ma non poteva rappresentare oggetti inesistenti in modo convincente; quella digitale, invece, può «far credere all’esistenza degli oggetti inesistenti che essa rappresenta».

Leone sottolinea che, per la prima volta nella storia della specie, agenti non umani producono falsi la cui valutazione non è più affidata all’uomo, ma a un altro algoritmo. In questo contesto, la semiotica è chiamata ad affrontare nuove aporie, interrogandosi sulle condizioni che producono l’effetto di realtà e sui limiti epistemici della distinzione tra vero e falso nel mondo digitale.

Riferimento bibliografico: Massimo Leone, I compiti principali di una semiotica dell’intelligenza artificiale, 2022